هدف از سیستم یادگیری ماشین تعیین خروجی اطلاعات دقیق و یا مغرضانه است.

به تازگی بررسی واقعیت جهان مشکلی از یک بحران کلی شده است. سایت هایی مانند Politifact و Snopes به طور سنتی در ادعای خاص که قابل تحسین است، اما خسته کننده متمرکز هستند; زمانی که آنها را از طریق تایید و یا واقعیت debunking واز شانس خوب آن در حال حاضر در سراسر جهان و بازگشت دوباره سفر است وجود دارد.

شرکت های رسانه های اجتماعی نیز داشته مخلوط نتیجه محدود کردن گسترش تبلیغات و اطلاعات غلط. فیس بوک به 20000 انسان مدیران این انجمن تا پایان سال طرح و منابع قابل توجهی را در حال توسعه الگوریتم های تشخیص به اخبار جعلی خود قرار دادن.

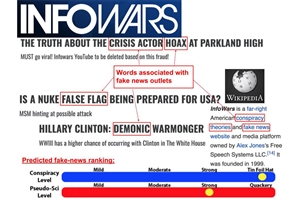

محققان از دانشگاه فنی ماساچوست علم رایانه و آزمایشگاه هوش مصنوعی (CSAIL) و قطر محاسبات تحقیق موسسه (QCRI) معتقدند که بهترین روش تمرکز نه تنها در فرد ادعا میکند اما در منابع خبری خود است. با استفاده از این میخ سرپهن کوچک آنها یک سیستم جدید است که با استفاده از دستگاه برای تعیین اگر منبع دقیق و یا گرایش سیاسی است یادگیری نشان داد.

اگر یک وب سایت جعلی اخبار قبل از منتشر شده است، امکان دارد خوب آنها آن را انجام دهد دوباره، میگوید postdoc Baly Ramy، نویسنده سرب در مقاله جدید در مورد سیستم. «توسط خودکار اطلاعات درباره این سایت انصراف، امید است که سیستم ما میتواند کمک به شکل از آنهایی که به احتمال زیاد آن را در وهله اول است.

Baly سیستم نیاز تنها حدود 150 مقاله به تشخیص قابل اعتماد اگر منبع خبر میتوان اعتماد کرد — معنی که رویکردی مانند آنها میتواند مورد استفاده برای کمک به قبل از داستان به گسترش بیش از حد گسترده کردن رسانه های جعلی و اخبار جدید تمبر.

سیستم همکاری بین دانشمندان کامپیوتر در MIT CSAIL و QCRI که بخشی از دانشگاه خلیفه بن حمد در قطر است. محققان ابتدا اطلاعات از رسانهها تعصب/حقیقت بررسی (MBFC)، یک وب سایت با انسانی واقعیت نادر است که دقت و سوگیرى سایت های خبری بیش از 2000 زمان; از MSNBC و فاکس نیوز; و از مزارع محتوا کم ترافیک.

آنها سپس تغذیه آن دادهها به دستگاه آموزش الگوریتم و برنامه ریزی آن به طبقه بندی سایت های خبری همانند MBFC. با توجه به رسانه جدید سیستم سپس 65 درصد دقیق در تشخیص این که آیا آن سطح بالا و پایین یا متوسط factuality است و حدود 70 درصد دقیق در تشخیص اگر متمایل به چپ، راست متمایل یا میانه رو بود که.

این تیم که مطمئن ترین راه برای تشخیص جعلی هر دو خبر و گزارش مغرضانه به نگاهی به ویژگی های زبانی مشترک در سراسر داستان منبع از جمله تمایلات پیچیدگی و ساختار گردید.

به عنوان مثال، رسانه های خبری جعلی داشت به احتمال زیاد به استفاده از زبان هذلولی ذهنی و عاطفی است. از نظر تعصب، رسانه های متمایل به چپ بیشتر احتمال دارد به زبان است که مربوط به مفاهیم آسیب/مراقبت و انصاف/عمل متقابل نسبت به خصوصیات دیگر مانند وفاداری و اختیار و حرمت شد. (این کیفیت representa تئوری — که وجود arefive اصلی مبانی اخلاقی — در روانشناسی اجتماعی. ).

شرکت نویسنده پرسلاو، Nakov دانشمند ارشد در QCRI، میگوید که سیستم نیز ارتباط با خروجی صفحه ویکی، که آن را برای عمومی مورد ارزیابی قرار یافت — دیگر قابل قبول تر است — به عنوان هدف کلمات مانند افراطی و یا تئوری توطئه. آن حتی بر داشت ارتباط با ساختار متن آدرس منبع: کسانی که به عنوان مثال، به حال بسیاری از شخصیت های ویژه و زیرشاخه های پیچیده، همراه با منابع کمتر شد.

از آنجا که بسیار ساده تر برای به دست آوردن زمین حقیقت در منابع [از در مقالات]، این روش قادر به ارائه مستقیم و پیش بینی های دقیق با توجه به نوع محتوا توزیع این منابع میگوید سیبیل Adali استاد علوم کامپیوتر در مؤسسه پلیتکنیک مؤسسه پلی تکنیک است که در این پروژه درگیر بود.

Nakov احتیاط که سیستم هنوز هم کار در حال پیشرفت است و که حتی با پیشرفت در دقت آن بهترین در رابطه با واقعیت جنگ نادر سنتی کار میاست.

اگر گزارش رسانه های متفاوت در یک موضوع خاص سایت مانند Politifact بلافاصله ما newsscores جعلی برای آنها تعیین چقدر اعتبار دادن به دیدگاه های مختلف میتواند در نگاه Nakov میگوید:.

نوشت: مقاله جدید با MIT ارشد تحقیقات جیمز دانشمند شیشهای کنار دانشجویان فارغ التحصیل Dimitar Alexandrov و گئورگی Karadzhov از دانشگاه صوفیه همکاری Baly و Nakov. این تیم در حال حاضر کار بعد از این ماه در سال 2018 روش های تجربی در کنفرانس زبان طبیعی پردازش (EMNLP) در بروکسل بلژیک.

محققان همچنین ایجاد شده جدید منبع باز مجموعه اطلاعات از بیش از 1،000 منابع خبری با نمره factuality و تعصب مشخص میشود که بزرگترین بانک اطلاعاتی نوع خود در جهان است. آیا سیستم آموزش زبان انگلیسی به زبان های دیگر، نیز به فراتر از تعصب چپ سنتی به اکتشاف سوگیرى منطقه خاص (مانند جهان اسلام تقسیم بین مذهبی و سکولار میتوان به عنوان گام های بعدی تیم کاوش خواهد شد ).

حمل و نقل میگوید این جهت تحقیقات میتواند نور را در چه وب سایت های غیرقابل اعتماد شبیه ریختن و نوع محتوا به اشتراک گذاشتن، که خواهد بود بسیار مفید برای طراحان وب و عمومی گسترده تر تمایل آندریاس Vlachos سخنران ارشد در دانشگاه کمبریج که در این پروژه درگیر بود.

Nakov میگوید که QCRI نیز قصد دارد نرم افزار است که کمک میکند تا کاربران گام از حباب های سیاسی خود را رول در پاسخ به اخبار خاص توسط کاربران ارائه مجموعهای از مقالات است که گستردگی طیف سیاسی است.

آن جالب به فکر راه های جدید برای ارائه خبر به مردم، میگوید: Nakov. ابزار مانند این افراد را کمی بیشتر به مسائل فکر و بررسی دیدگاه های دیگر که آنها نه در غیر این صورت در نظر گرفته ممکن است میتواند کمک.

لطفاً در مورد مطلب فوق ستاره بدهید :

طراحی سایت تشخیص اخبار جعلی با توجه به منبع آن توسط سیستم یادگیری ماشین Rated 4.3 / 5 based on 3 reviews.

آیا این مقاله برای شما مفید بود؟